Distribuzione di Poisson

| Distribuzione di Poisson | |

|---|---|

Funzione di distribuzione discreta  | |

Funzione di ripartizione | |

| Parametri | |

| Supporto | |

| Funzione di densità | |

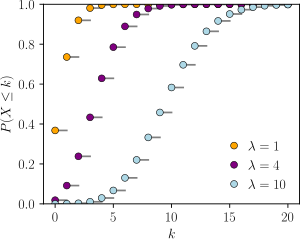

| Funzione di ripartizione | (dove è la funzione gamma incompleta) |

| Valore atteso | |

| Mediana | circa |

| Moda | sia che se |

| Varianza | |

| Indice di asimmetria | |

| Curtosi | |

| Entropia | |

| Funzione generatrice dei momenti | |

| Funzione caratteristica | |

| Manuale | |

In teoria delle probabilità la distribuzione di Poisson (o poissoniana) è una distribuzione di probabilità discreta che esprime le probabilità per il numero di eventi che si verificano successivamente ed indipendentemente in un dato intervallo di tempo, sapendo che mediamente se ne verifica un numero . Ad esempio, si utilizza una distribuzione di Poisson per misurare il numero di chiamate ricevute in un call-center in un determinato arco temporale, come una mattinata lavorativa. Questa distribuzione è anche nota come legge degli eventi rari.

Prende il nome dal matematico francese Siméon-Denis Poisson.

Definizione

La distribuzione di Poisson è una distribuzione di probabilità discreta data da

- per ogni ,

dove è il numero medio di eventi per intervallo di tempo, mentre è il numero di eventi per intervallo di tempo (lo stesso col quale si misura ) di cui si vuole la probabilità.

Dallo sviluppo in serie dell'esponenziale si trova .

Convergenza

La distribuzione di Poisson può essere ottenuta come limite delle distribuzioni binomiali , con , ovvero si ha una convergenza in legge di a . Per questa convergenza la distribuzione di Poisson è anche nota come legge (di probabilità) degli eventi rari.

In statistica si adotta l'approssimazione della distribuzione binomiale tramite la distribuzione di Poisson quando n>20 e p<1/20, o preferibilmente quando n>100 e np<10.

Caratteristiche

Una variabile aleatoria Y di distribuzione di Poisson ha

- (Riscriviamo come )

- indici di antisimmetria (in inglese: skewness) e di curtosi

- ,

- entropia

che ha un andamento

Proprietà

Se e sono due variabili aleatorie indipendenti con distribuzioni di Poisson di parametri e rispettivamente, allora

- la loro somma segue ancora una distribuzione di Poisson, di parametro ;

- la distribuzione di condizionata da è la distribuzione binomiale di parametri e .

Più in generale, la somma di n variabili aleatorie indipendenti con distribuzioni di Poisson di parametri segue una distribuzione di Poisson di parametro , mentre la distribuzione di condizionata da è la distribuzione binomiale di parametri e .

Distribuzioni collegate

Se la distribuzione di Poisson di parametro descrive il numero di eventi in un intervallo di tempo, il tempo di attesa tra due eventi successivi è descritto dalla distribuzione esponenziale di parametro .

La distribuzione di Skellam è definita come la distribuzione della differenza tra due variabili aleatorie indipendenti aventi entrambe distribuzioni di Poisson.

La mistura di distribuzioni tra la distribuzione di Poisson e la distribuzione Gamma (che governa il parametro ) è la distribuzione di Pascal, che talvolta è anche detta Gamma-Poisson.

La distribuzione di Panjer, definita per ricorsione, generalizza la distribuzione di Poisson: .

Statistica

Approssimazioni

Per una variabile aleatoria con distribuzione di Poisson viene solitamente approssimata con la distribuzione normale ; per parametri più piccoli () sono invece necessarie delle correzioni di continuità, legate ai diversi domini delle due distribuzioni (una discreta, una continua).

La radice quadrata di una variabile aleatoria con distribuzione di Poisson è approssimata da una distribuzione normale meglio di quanto lo sia la variabile stessa.

Il parametro può essere stimato come la media delle osservazioni effettuate. Questo stimatore è privo di bias, ovvero ha come valore atteso stesso.

Inferenza bayesiana

Se il parametro di una distribuzione di Poisson è distribuito a priori secondo la distribuzione Gamma, allora lo è anche a posteriori dell'osservazione .

Intervallo di confidenza per la media

Un criterio rapido per il calcolo approssimato dell'intervallo di confidenza della media campionaria è fornito in Guerriero (2012). Dato un numero k di eventi (almeno 15-20 per un'approssimazione soddisfacente) registrati in un certo intervallo di tempo - o di lunghezza, volume etc. -, i limiti dell'intervallo di confidenza per il parametro λ sono dati da:

Storia

Questa distribuzione fu introdotta da Siméon-Denis Poisson nel 1838 nel suo articolo Recherches sur la probabilité des jugements en matière criminelle et en matière civile[1][2]. Secondo alcuni storici questa variabile casuale dovrebbe portare il nome di Ladislaus Bortkevič considerati gli studi fatti da questo nel 1898.[3]

In realtà la poissoniana come approssimazione della binomiale era già stata introdotta nel 1718 da Abraham de Moivre in Doctrine des chances.[4]

Tavole dei valori della funzione di probabilità

λ = 0,1; 0,2; ... 1,0

| k | 0,1 | 0,2 | 0,3 | 0,4 | 0,5 | 0,6 | 0,7 | 0,8 | 0,9 | 1,0 |

|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 0,9048 | 0,8187 | 0,7408 | 0,6703 | 0,6065 | 0,5488 | 0,4966 | 0,4493 | 0,4066 | 0,3679 |

| 1 | 0,0905 | 0,1637 | 0,2222 | 0,2681 | 0,3033 | 0,3293 | 0,3476 | 0,3595 | 0,3659 | 0,3679 |

| 2 | 0,0045 | 0,0164 | 0,0333 | 0,0536 | 0,0758 | 0,0988 | 0,1217 | 0,1438 | 0,1647 | 0,1839 |

| 3 | 0,0002 | 0,0011 | 0,0033 | 0,0072 | 0,0126 | 0,0198 | 0,0254 | 0,0383 | 0,0494 | 0,0613 |

| 4 | 0,0001 | 0,0003 | 0,0007 | 0,0016 | 0,0030 | 0,0050 | 0,0077 | 0,0111 | 0,0153 | |

| 5 | 0,0001 | 0,0002 | 0,0004 | 0,0007 | 0,0012 | 0,0020 | 0,0031 | |||

| 6 | 0,0001 | 0,0002 | 0,0003 | 0,0005 | ||||||

| 7 | 0,0001 |

λ = 1,2; 1,4; ... 3,0

| k | 1,2 | 1,4 | 1,6 | 1,8 | 2,0 | 2,2 | 2,4 | 2,6 | 2,8 | 3,0 |

|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 0,3012 | 0,2466 | 0,2019 | 0,1653 | 0,1353 | 0,1108 | 0,0907 | 0,0743 | 0,0608 | 0,0498 |

| 1 | 0,3614 | 0,3452 | 0,3230 | 0,2975 | 0,2707 | 0,2438 | 0,2177 | 0,1931 | 0,1703 | 0,1494 |

| 2 | 0,2169 | 0,2417 | 0,2584 | 0,2678 | 0,2707 | 0,2681 | 0,2613 | 0,2510 | 0,2384 | 0,2240 |

| 3 | 0,0867 | 0,1128 | 0,1378 | 0,1607 | 0,1804 | 0,1966 | 0,2090 | 0,2176 | 0,2225 | 0,2240 |

| 4 | 0,0260 | 0,0395 | 0,0551 | 0,0723 | 0,0902 | 0,1082 | 0,1254 | 0,1414 | 0,1557 | 0,1680 |

| 5 | 0,0062 | 0,0111 | 0,0176 | 0,0260 | 0,0361 | 0,0476 | 0,0602 | 0,0735 | 0,0872 | 0,1008 |

| 6 | 0,0012 | 0,0026 | 0,0047 | 0,0078 | 0,0120 | 0,0174 | 0,0241 | 0,0319 | 0,0407 | 0,0504 |

| 7 | 0,0002 | 0,0005 | 0,0011 | 0,0020 | 0,0034 | 0,0055 | 0,0083 | 0,0118 | 0,0163 | 0,0216 |

| 8 | 0,0001 | 0,0002 | 0,0005 | 0,0009 | 0,0015 | 0,0025 | 0,0038 | 0,0057 | 0,0081 | |

| 9 | 0,0001 | 0,0002 | 0,0004 | 0,0007 | 0,0011 | 0,0018 | 0,0027 | |||

| 10 | 0,0001 | 0,0002 | 0,0003 | 0,0005 | 0,0008 | |||||

| 11 | 0,0001 | 0,0001 | 0,0002 | |||||||

| 12 | 0,0002 |

λ = 3,5; 4,0; ... 8,0

| k | 3,5 | 4,0 | 4,5 | 5,0 | 5,5 | 6,0 | 6,5 | 7,0 | 7,5 | 8,0 |

|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 0,0302 | 0,0183 | 0,0111 | 0,0067 | 0,0041 | 0,0025 | 0,0015 | 0,0009 | 0,0006 | 0,0003 |

| 1 | 0,1057 | 0,0733 | 0,0500 | 0,0337 | 0,0225 | 0,0149 | 0,0098 | 0,0064 | 0,0041 | 0,0027 |

| 2 | 0,1850 | 0,1465 | 0,1125 | 0,0842 | 0,0618 | 0,0446 | 0,0318 | 0,0223 | 0,0156 | 0,0107 |

| 3 | 0,2158 | 0,1954 | 0,1687 | 0,1404 | 0,1133 | 0,0892 | 0,0688 | 0,0521 | 0,0389 | 0,0286 |

| 4 | 0,1888 | 0,1954 | 0,1898 | 0,1755 | 0,1558 | 0,1339 | 0,1118 | 0,0912 | 0,0729 | 0,0573 |

| 5 | 0,1322 | 0,1563 | 0,1708 | 0,1755 | 0,1714 | 0,1606 | 0,1454 | 0,1277 | 0,1094 | 0,0916 |

| 6 | 0,0771 | 0,1042 | 0,1281 | 0,1462 | 0,1571 | 0,1606 | 0,1575 | 0,1490 | 0,1367 | 0,1221 |

| 7 | 0,0385 | 0,0595 | 0,0824 | 0,1044 | 0,1234 | 0,1377 | 0,1462 | 0,1490 | 0,1465 | 0,1396 |

| 8 | 0,0169 | 0,0298 | 0,0463 | 0,0653 | 0,0849 | 0,1033 | 0,1188 | 0,1304 | 0,1373 | 0,1396 |

| 9 | 0,0066 | 0,0132 | 0,0232 | 0,0363 | 0,0519 | 0,0688 | 0,0858 | 0,1014 | 0,1144 | 0,1241 |

| 10 | 0,0023 | 0,0053 | 0,0104 | 0,0181 | 0,0285 | 0,0413 | 0,0558 | 0,0710 | 0,0858 | 0,0993 |

| 11 | 0,0007 | 0,0019 | 0,0043 | 0,0082 | 0,0143 | 0,0225 | 0,0330 | 0,0452 | 0,0585 | 0,0722 |

| 12 | 0,0002 | 0,0006 | 0,0016 | 0,0034 | 0,0065 | 0,0113 | 0,0179 | 0,0263 | 0,0366 | 0,0481 |

| 13 | 0,0001 | 0,0002 | 0,0006 | 0,0013 | 0,0028 | 0,0052 | 0,0089 | 0,0142 | 0,0211 | 0,0296 |

| 14 | 0,0001 | 0,0002 | 0,0005 | 0,0011 | 0,0022 | 0,0041 | 0,0071 | 0,0113 | 0,0169 | |

| 15 | 0,0001 | 0,0002 | 0,0004 | 0,0009 | 0,0018 | 0,0033 | 0,0057 | 0,0090 | ||

| 16 | 0,0001 | 0,0003 | 0,0007 | 0,0014 | 0,0026 | 0,0045 | ||||

| 17 | 0,0001 | 0,0003 | 0,0006 | 0,0012 | 0,0021 | |||||

| 18 | 0,0001 | 0,0002 | 0,0005 | 0,0009 | ||||||

| 19 | 0,0001 | 0,0002 | 0,0004 | |||||||

| 20 | 0,0001 | 0,0002 | ||||||||

| 21 | 0,00001 |

Note

- ^ (EN) Jan Gullberg, Mathematics from the birth of numbers, W. W. Norton & Company, 1997, pp. 963-965, ISBN 978-0-393-04002-9.

- ^ Filippo Siriani, Enciclopedia delle Matematiche elementari e complementi, vol. III, Milano, Hoepli Editore, 1954, p. 214.

- ^ (DE) Ladislaus von Bortkevič, Das Gesetz der kleinen Zahlen, Lipsia, B.G. Teubner, 1898, p. 1.

(EN) Bortkiewicz presents his famous analysis of "4. Beispiel: Die durch Schlag eines Pferdes im preussischen Heere Getöteten." (4. Example: Those killed in the Prussian army by a horse's kick, su books.google.com, pp. 23–25. - ^ (EN) Johnson, N.L., Kotz, S. e Kemp, A.W., Univariate Discrete distributions, 2ª ed., Wiley, 1993, p. 157, ISBN 0-471-54897-9.

Bibliografia

- (EN) Donald E. Knuth, Seminumerical Algorithms, The Art of Computer Programming, Volume 2, Addison-Wesley, 1969.

- (EN) Ronald J. Evans, J. Boersma, N. M. Blachman, A. A. Jagers, The Entropy of a Poisson Distribution: Problem 87-6, in SIAM Review, vol. 30, n. 2, 1988, pp. 314–317, DOI:10.1137/1030059.

- Sheldon M. Ross, Probabilità e statistica per l'ingegneria e le scienze, Trento, Apogeo, 2003, ISBN 88-7303-897-2.

- Vincenzo Guerriero, Power Law Distribution: Method of Multi-scale Inferential Statistics, in J. Mod. Math. Fr., 2012, pp. 21–28.

Voci correlate

Altri progetti

Altri progetti

- Wikimedia Commons

Wikimedia Commons contiene immagini o altri file sulla distribuzione di Poisson

Wikimedia Commons contiene immagini o altri file sulla distribuzione di Poisson

Collegamenti esterni

- Poisson, distribuzione di, in Enciclopedia della Matematica, Istituto dell'Enciclopedia Italiana, 2013.

- Poisson, distribuzione di, in Dizionario di Economia e Finanza, Istituto dell'Enciclopedia Italiana, 2012.

- (EN) Richard Routledge, Poisson distribution, su Enciclopedia Britannica, Encyclopædia Britannica, Inc.

- (EN) Eric W. Weisstein, Poisson Distribution, su MathWorld, Wolfram Research.

- (EN) Poisson distribution, su Encyclopaedia of Mathematics, Springer e European Mathematical Society.

- (EN) Poisson distribution, in Free On-line Dictionary of Computing, Denis Howe. Disponibile con licenza GFDL

- (EN) IUPAC Gold Book, "Poisson distribution", su goldbook.iupac.org.

| Controllo di autorità | LCCN (EN) sh85103956 · GND (DE) 4253010-6 · J9U (EN, HE) 987007558217205171 · NDL (EN, JA) 00569122 |

|---|

Portale Matematica: accedi alle voci di Wikipedia che trattano di matematica

Portale Matematica: accedi alle voci di Wikipedia che trattano di matematica

![{\displaystyle \left[\lambda +{\frac {1}{3}}-{\frac {1}{50\lambda }}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cfea254abf1c9d1b88c90c57a8bac8c491f00d00)

![{\displaystyle [\lambda ]\ }](https://wikimedia.org/api/rest_v1/media/math/render/svg/b97ad4b85e40b706a2d55c7c21f5ee1b1680ce6c)

![{\displaystyle E[Y]=\sum _{n=0}^{\infty }n{\frac {\lambda ^{n}}{n!}}e^{-\lambda }=\sum _{n=1}^{\infty }n{\frac {\lambda ^{n}}{n!}}e^{-\lambda }=\lambda e^{-\lambda }\sum _{n=1}^{\infty }{\frac {\lambda ^{n-1}}{(n-1)!}}=\lambda e^{-\lambda }\sum _{n=0}^{\infty }{\frac {\lambda ^{n}}{n!}}=\lambda }](https://wikimedia.org/api/rest_v1/media/math/render/svg/7d5a73df0d2061ee5acc436b41013cbba80810b8)

![{\displaystyle {\begin{aligned}{\text{Var}}(Y)&=E[Y^{2}]-(E[Y])^{2}\\&=\sum _{n=0}^{\infty }n^{2}{\frac {\lambda ^{n}}{n!}}e^{-\lambda }-\lambda ^{2}\\&=\sum _{n=0}^{\infty }n(n-1){\frac {\lambda ^{n}}{n!}}e^{-\lambda }+\sum _{n=0}^{\infty }n{\frac {\lambda ^{n}}{n!}}e^{-\lambda }-\lambda ^{2}\\&=\sum _{n=2}^{\infty }n(n-1){\frac {\lambda ^{n}}{n!}}e^{-\lambda }+\lambda -\lambda ^{2}\\&=\lambda ^{2}e^{-\lambda }\sum _{n=2}^{\infty }{\frac {\lambda ^{(n-2)}}{(n-2)!}}+\lambda -\lambda ^{2}\\&=\lambda ^{2}+\lambda -\lambda ^{2}\\&=\lambda \end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fb9cfb2f4417f80fcbec0eef4d19063b9c8762f8)

![{\displaystyle g(t,Y)=E[e^{tY}]=e^{-\lambda }\sum _{n=0}^{\infty }{\frac {\lambda ^{n}e^{tn}}{n!}}=e^{-\lambda }e^{\lambda e^{t}}=e^{\lambda (e^{t}-1)}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cb5e6ba9aa479a699bbabecec18a968e2a586cbf)